Documento que defende uso ético da IA na educação cita fontes inexistentes

Publicado em 12 de setembro de 2025 às 19:03

2 min de leituraIA não é tão confiável em contextos acadêmicos

• O relatório “Education Accord” de Terra Nova e Labrador, no Canadá, cita pelo menos 15 fontes inexistentes, incluindo um filme fictício chamado “Schoolyard Games”.

• Existe a suspeita de que a IA tenha sido usada na elaboração do documento, pois modelos de linguagem podem criar informações falsas, em um fenômeno conhecido como “alucinação”.

• Especialistas expressam preocupações sobre a confiabilidade do documento devido às citações inventadas.

Um documento com planos educacionais do governo da província de Terra Nova e Labrador, no Canadá, está no centro de uma polêmica: pelo menos 15 fontes citadas como referências não existem, o que levanta suspeitas de que ferramentas de inteligência artificial foram usadas na escrita.

O relatório, intitulado “Education Accord”, tem mais de 400 páginas e levou 18 meses para ser elaborado. Ironicamente, entre suas sugestões de medidas pedagógicas, ele inclui a capacitação de alunos e educadores com “conhecimentos básicos de IA, incluindo ética, privacidade de dados e uso responsável da tecnologia”.

Quais são as fontes falsas no documento?

O documento cita um filme produzido pela National Film Board do Canadá chamado “Schoolyard Games”, mas, segundo a entidade, esse filme simplesmente não existe. Curiosamente, um filme com esse mesmo nome é mencionado em um guia de escrita da Universidade de Vitória (Canadá). É um exemplo fictício, para ensinar como formatar citações corretamente.

Documento inclui uso ético de IA entre recomendações pedagógicas (foto: Stocksnap/Pixabay)

Aaron Tucker, professor assistente da Universidade Memorial de Terra Nova, disse não ter conseguido encontrar várias fontes citadas, mesmo procurando no Google, na biblioteca da instituição e em outros bancos de dados acadêmicos.

“Se [o relatório] foi feito por IA, eu não sei, mas inventar fontes é um sinal revelador do uso de inteligência artificial”, diz Tucker, que pesquisa a história da tecnologia no Canadá.

Por que as fontes falsas levantam suspeitas sobre o uso de IA?

Chatbots de IA, apesar de suas capacidades impressionantes de escrita, pesquisa e programação, podem “alucinar”, termo usado para descrever quando um robô cria um resultado aparentemente coerente, mas falso. Um tipo comum é justamente inventar informações, e isso é ainda mais acentuado quando se trata de nomes de obras como livros, artigos, filmes e discos, entre outros.

Isso acontece porque a IA generativa se baseia em modelos de linguagem em larga escala (LLMs), que são treinados para reconhecer padrões em quantidades enormes de textos, mas nem sempre são capazes de identificar se uma informação é verdadeira ou não.

Fonte: Tecnoblog

Leia também

- The Batman - Part II retorna a Glasgow como a cidade 'especial' que define o visual de Gotham

Diretor Matt Reeves confirma que Glasgow voltará a servir como base visual de Gotham City em The Batman - Part II, destacando a importância da arquitetura única da cidade.

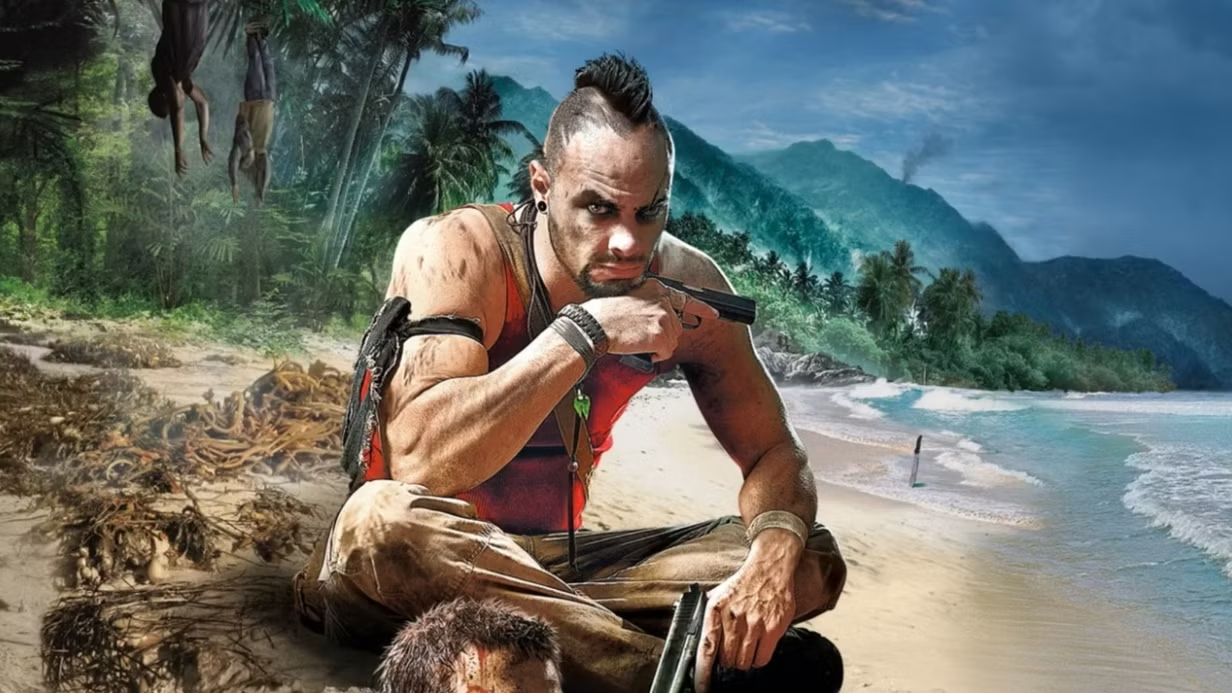

💬 0 - FX encomenda série de Far Cry criada por Noah Hawley e Rob Mac

A franquia Far Cry ganhará sua primeira adaptação live-action de alto orçamento. A FX confirmou a produção de uma série antológica desenvolvida por Noah Hawley e Rob Mac, com estreia futura no Hulu e Disney+.

💬 0 - Diretor de The Flash defende o filme e critica negatividade online: “Muitas pessoas sequer assistiram”

O diretor Andy Muschietti quebrou o silêncio e saiu em defesa de The Flash, filme que protagonizou um dos casos mais emblemáticos de fracasso comercial da DC nos cinemas. Em entrevista recente ao The Playlist, Muschietti manteve sua posição de orgulho pelo longa, mesmo após a recepção morna do público e da crítica, al…

💬 0