Auditoria usa IA, passa vergonha e devolve dinheiro de projeto

Publicado em 7 de outubro de 2025 às 11:57

2 min de leituraRelatório continha citação inventada e estudos que nunca existiram • A Deloitte, uma das principais empresas de consultoria do mundo, usou IA em um relatório para o governo australiano.

• O documento avaliado em AU$ 439 mil teve citações fictícias e foi corrigido após críticas e investigação interna.

• A empresa acordou um reembolso parcial, e o governo não pagará a última parcela do contrato.

A gigante da consultoria Deloitte vai renunciar parte de um pagamento avaliado em AU$ 439.000 (pouco mais de R$ 1,5 milhão, na cotação atual). O motivo? A entrega de um relatório para o governo da Austrália com vários erros atribuídos ao uso de inteligência artificial, incluindo citações e referências falsas.

Em dezembro do ano passado, o Departamento de Emprego e Relações de Trabalho (DEWR) contratou a empresa para auditar e revisar um sistema que aplica penalidades automáticas a beneficiários de programas de emprego.

Segundo o jornal Financial Review, um relatório inicial foi publicado em julho deste ano, mas menos de um mês depois suas imprecisões foram expostas por um acadêmico da Universidade de Sydney, o Dr. Christopher Rudge.

O acadêmico levantou a hipótese de que os erros poderiam ser “alucinações” de IA — fenômeno no qual a tecnologia inventa informações para responder a consultas. Após a denúncia, a Deloitte iniciou uma investigação e publicou uma versão corrigida do relatório na última semana.

O texto revisado revela que parte da análise inicial “incluiu o uso de ferramentas de IA generativa (GPT-4o)”. O governo afirma que as recomendações do documento não foram alteradas, mas o incidente expôs os riscos do uso crescente, e por vezes não supervisionado, da IA em serviços técnicos.

“Alucinações”, erros e citações falsas

Consultoria admite que falhas foram geradas por modelo GPT-4oO documento original continha mais de uma dúzia de referências e notas de rodapé incorretas. Entre as mais notáveis estavam citações a dois relatórios fictícios da professora Lisa Burton Crawford, da Universidade de Sydney, e outras duas referências a um trabalho inexistente do professor Björn Regnell, da Universidade de Lund, na Suécia. Além disso, o documento inventou uma citação sobre uma decisão do Tribunal Federal australiano e até errou a grafia do nome da juíza do caso.

Ao Financial Review, o acadêmico Chris Rudge — que identificou os erros — criticou a gravidade das falhas após a admissão da consultoria. Para ele, a credibilidade de todo o trabalho ficou comprometida. “Não se pode confiar nas recomendações quando a própria base do relatório é construída sobre uma metodologia falha”, afirmou.

Reembolso parcial do contrato

Fonte: Tecnoblog

Leia também

- The Batman - Part II retorna a Glasgow como a cidade 'especial' que define o visual de Gotham

Diretor Matt Reeves confirma que Glasgow voltará a servir como base visual de Gotham City em The Batman - Part II, destacando a importância da arquitetura única da cidade.

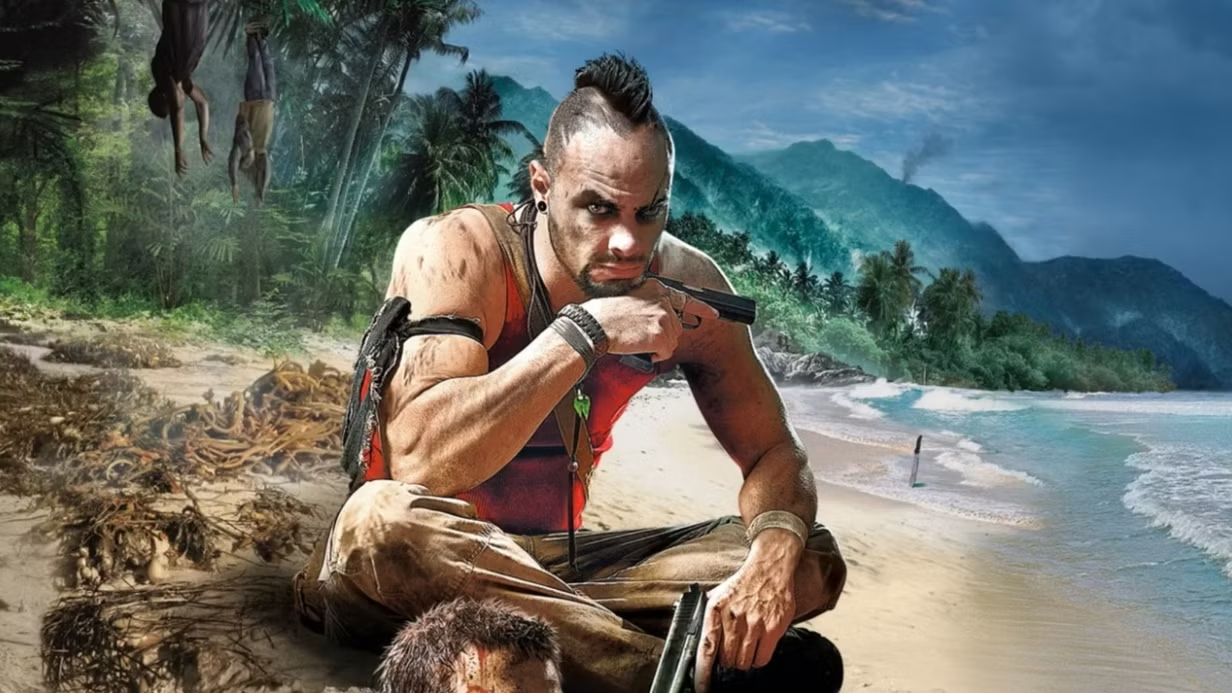

💬 0 - FX encomenda série de Far Cry criada por Noah Hawley e Rob Mac

A franquia Far Cry ganhará sua primeira adaptação live-action de alto orçamento. A FX confirmou a produção de uma série antológica desenvolvida por Noah Hawley e Rob Mac, com estreia futura no Hulu e Disney+.

💬 0 - Apple TV+ passa a se chamar apenas Apple TV

Apple TV agora será o nome oficial do streaming da empresaResumo

💬 0